Le basi concettuali e l'economia della neutralita' della rete [Parte 2] - 14 maggio 2009, Roma

Questa e' la seconda parte del mio resoconto del convegno nnsquad.it tenutosi a Roma il 14 maggio 2009, ospitato dalla fondazione di consulenti ICT Fondazione Ugo Bordoni.

Nella prima parte ho descritto la sessione mattutina, dedicata alla definizione della neutralita' della rete e a come l'economia globale possa conciliarsi con essa. Il pomeriggio e' stato dedicato a interventi piu' tecnici, e ho avuto l'occasione di sentire le osservazioni dei portavoce delle telco sulla situazione attuale e sui possibili sviluppi futuri.

Il primo intervento e' iniziato alle 14:15 ed e' stato tenuto dal prof. Vittorio Trecordi (slide disponibili qui). Lo ha introdotto affermando che la net neutrality potrebbe potenzialmente contrastare con lo sviluppo economico e le esigenze di sicurezza, a causa delle intercettazioni necessarie per queste ultime, intercettazioni che sono fortemente contrarie alla liberta' individuale di comunicare.

Stranamente (o forse no), non e' stato fatto alcun cenno ai modi attuali per aggirare sia le intercettazioni che la localizzazione dei comunicanti: mi riferisco al progetto Tor, il piu' noto bastione che garantisce la privacy ed e' attualmente usato da giornalisti che lavorano in zone "calde", tra molti altri.

Un altro punto sulla legislazione e' che non e' uguale in tutti i paesi, sebbene Internet sia diffuso in tutto il mondo; inoltre dovremmo definire su quali reti valutare la neutralita', perche' non necessariamente una rete IP e' connessa a Internet (pensate ai walled garden di proprieta' degli ISP).

Inoltre, di nuovo sulla Quality of Service: Trecordi ha affermato che Internet ha avuto successo grazie al suo "modello a clessidra" e alla “capacita' di disaccoppiare i servizi di comunicazione dall'infrastruttura di rete”, ma i requisiti di QoS (ad es. per il VoIP) stressano la pila protocollare, soprattutto dove i condotti di rete sono “in overbooking”. Inoltre, anche l'overprovisioning fallisce, a causa dell'architettura decentralizzata di Internet, e i colli di bottiglia si trovano principalmente nei punti di interconnessione tra ISP.

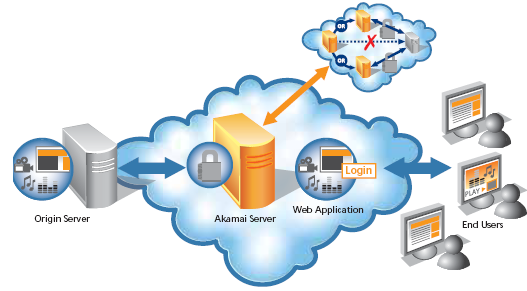

Quindi, Internet e' una piattaforma best-effort, dove un ISP non puo' controllare come i pacchetti dei suoi clienti verranno trattati una volta varcati i suoi confini e raggiunto un provider geograficamente distante. In quest'area risiede il modello di business delle content delivery network, che usiamo in modo trasparente ogni giorno per accedere a siti web molto trafficati, e che hanno anche causato qualche divertente malinteso in passato, quando Akamai ha iniziato a fare da proxy per Microsoft con Squid su Linux, e Netcraft ha mostrato nelle sue statistiche che i server Microsoft girano su Linux :).

Fonte: Akamai

A parte quella battuta divertente (del 2001), le CDN accorciano il percorso di routing tra gli utenti e il contenuto statico di un servizio, usando data center distribuiti geograficamente che eseguono Varnish (o software equivalente) e un server DNS con geolocalizzazione come PowerDNS. In questo modo, quando un client qualsiasi cerca di risolvere un hostname, il DNS risponde con l'indirizzo IP virtuale del datacenter piu' vicino, e poi serve il contenuto dalla cache.

Questi sono approcci che cercano di mitigare la natura best-effort di Internet, ma forse ci sono soluzioni migliori. Le NGN puntano a essere una di queste, fornendo pipe di rete multiple dedicate a erogare diversi tipi di traffico di rete, con le loro specifiche esigenze di QoS. Specialmente nelle connessioni di peering tra ISP, che dovrebbero fornire SLA per garantire una QoS globale (pur sempre best-effort :) tra le reti. QoS pienamente garantita era ed e' assicurata solo nei walled garden.

Un altro approccio per accorciare i percorsi di routing e il carico su singoli punti della rete e' usare una tabella hash distribuita, o DHT in breve, che implementa un'infrastruttura distribuita decentralizzata sulla quale si possono costruire servizi efficienti come file system distribuiti, condivisione peer-to-peer, e in generale sistemi di distribuzione di contenuti. BitTorrent e' un esempio di DHT, come lo e' Kademlia usata dal popolare software di file sharing eMule. Un altro esempio e' RELOAD, attualmente (ancora) in stato di draft, usato per implementare SIP peer-to-peer, e quindi un'infrastruttura VoIP decentralizzata senza un grande nome dietro. Non mi sorprende che RELOAD e P2PSIP non siano stati menzionati nel talk.

Ovviamente ne' le NGN ne' le tecnologie P2P/CDN copriranno l'intera internet in breve tempo: la buona vecchia rete galleggera' su queste nuove tecnologie e su quelle legacy (come IPv4) nei prossimi anni, perche' cambiare infrastruttura di rete impone costi pesanti agli ISP. Ci si potrebbe chiedere se anche i content provider dovrebbero contribuire allo sviluppo dell'infrastruttura di rete, dato che sono loro a beneficiare di maggiore banda e minore latenza. Il prof. Trecordi ha detto di si', Google usa 21 volte piu' banda di quella che paga. Cavolo. LaTeX non basta per fare contenuti, signor Ph.D. Questo commento spiega il mio punto di vista sulla questione, ed e' stato esposto anche da un membro del pubblico successivamente.

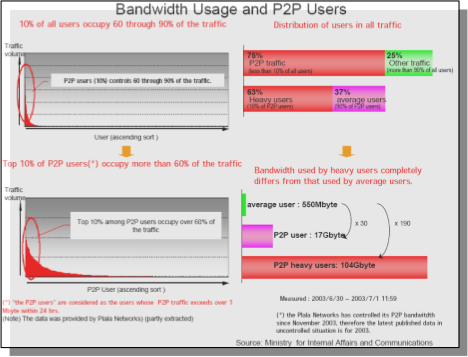

Fonte: slide di Trecordi

Qualunque infrastruttura di rete adotteremo in futuro, non possiamo prescindere da un fatto nudo e crudo: solo una minoranza degli utenti consumera' la maggioranza della banda... come e' successo con Napster nel 2000, quando il software di Shawn Fanning si dice consumasse l'80% della banda esterna aggregata del suo college. Considerando questo scenario, il relatore ha sostenuto che e' ragionevole per gli ISP mettere limiti su servizi specifici (file sharing uber alles) per limitare il modello “all you can eat”, perche' i pochi utenti che fanno un uso massiccio potrebbero effettivamente impattare quelli che usano meno risorse. Ho opinioni contrastanti su questo, perche' gli ISP troppo spesso superano il limite... e limiti ragionevoli possono troppo facilmente diventare inaccettabili.

Poi il professore ha parlato di P4P come possibile fattore di mitigazione della congestione di rete. P4P significa che gli ISP collaborano con gli implementatori di client BitTorrent per sviluppare versioni personalizzate che ottimizzino le connessioni P2P tra i clienti. In cosa consiste questa ottimizzazione? In breve, nel non favorire i client piu' veloci, ma quelli piu' vicini, in termini di hop di routing. Questo avviene tramite un iTracker dedicato configurato dall'ISP (ahi!) che contiene informazioni aggiuntive sulla posizione fisica dei client, e puo' cosi' indirizzare le connessioni P2P verso quelli piu' vicini.

Il lato oscuro del P4P, come sottolinea Ernesto fondatore di Torrentfreak, e' che puo' aprire un vaso di Pandora, perche' il gruppo di lavoro P4P "include alcuni membri prominenti dell'industria dell'intrattenimento e noti lobbisti anti-pirateria" (scusate ma l'evidenziatore non ha funzionato bene su questa pagina). Non posso dire che Ernesto abbia torto, anche per dichiarazioni come quella fatta ieri 15 maggio 2009 dal CEO di Sony Pictures: "niente di buono e' venuto da internet, punto.". Eh. Nessun commento.

Poi, DPI (Deep Packet Inspection). Gli ISP possono usarla? E per quali scopi? Sicurezza? Be', potrebbe funzionare, fintanto che procedure automatiche filtrano SPAM e virus dalle reti residenziali, ok... ma AT&T ha usato Narus e fibra sdoppiata per identificare e raccogliere dati di chiamate VoIP, la DPI puo' anche essere usata per erogare pubblicita' mirata, e puo' essere abusata fin troppo facilmente: in Italia abbiamo avuto il famigerato scandalo di spionaggio del Tiger Team, quindi abbiamo bisogno di regole precise per regolamentare queste tecnologie potenzialmente pericolose e assicurarci che gli ISP le rispettino. Serve una dose enorme di Fede, direi.

Foto di shrued

Tavola rotonda con i portavoce delle telco

Questa era la parte davvero interessante dell'evento: vedere uomini che rappresentano le telco parlare tra di loro di questioni legate a Internet, e riferirsi l'un l'altro come le aziende che rappresentano. Piuttosto divertente, considerando lo status quo piuttosto complicato qui in Italia (concessioni governative, cavi dell'ultimo miglio di proprieta' di una sola azienda per ragioni storiche, e cosi' via).

Le parti coinvolte (e i punti chiave condensati) erano:

Paolo di Domenico – Vodafone – (Punteggio: 3)- Gli utenti pesanti non dovrebbero poter degradare l'esperienza degli altri clienti

- Non bloccheremo il traffico su base applicativa

- Dovremmo poter gestire il carico di traffico e mettere limiti quando siamo oltre capacita'

- La trasparenza di SLA e TOS e' un must

Anton Giulio Lombardi – Tre – (Punteggio: 3)- I dispositivi stanno migliorando e diventando multi-connessi (wifi, gsm, hsdpa), questo implica convergenza di servizi che oggi sono separati (telefonia e internet)

- Frequenze: il 6 maggio 2009 in Italia e' stata votata una proposta di legge che, se approvata, permettera' agli operatori mobili di fare un uso piu' ampio delle frequenze di quanto sia possibile ora

- I contenuti vengono partizionati dai produttori per ottenere piu' ricavi; i dispositivi multi-connessi che tipo di accesso forniscono? Ad es. un PC con un modulo HSDPA che tipo di accesso fornisce? Broadband? UMTS? Servono regolamentazioni sensate per alleggerire il carico sugli operatori mobili, o tutti inizieranno a usare piattaforme non compatibili. (Davvero non ho capito il suo punto).

- Di nuovo sulle regolamentazioni: le persone potrebbero usare i nostri cellulari (70M in Italia) per i pagamenti, ma la legislazione non e' pronta. Inoltre, la nostra azienda trasmette la televisione RAI via DVBH, ma la RAI non trasmette da sola. Piuttosto strano.

Raffaele Mosca – Wind – (Punteggio: 3)- La neutralita' e' la base comune da cui partire per qualsiasi ulteriore discussione. Non possiamo bloccare l'accesso a un sito come CNN o Al Jazeera per nessun motivo

- Potremmo definire un minimo comun denominatore in un insieme di servizi che dia neutralita' e non necessiti di QoS. Dato che IP e' un protocollo best-effort, nessuno dovrebbe investire in risorse di rete non usate efficientemente (a causa del file sharing, nota del redattore).

- Alla fine, servono regolamentazioni sane e precise, perche' in un contesto commerciale con piu' attori ognuno cerca di tirare l'acqua al proprio mulino (e odio questo stato di cose, nota del redattore)

Stefano Nocentini – Telecom Italia – (Punteggio: 5, Perspicace)- Pensate a Internet come

un'autostrada, cosi' possiamo ragionare meglio.

- I limiti di velocita' equivalgono ai limiti di banda, perche' puoi raggiungerli, ma non quando c'e' un ingorgo.

- Un'autostrada e' dimensionata su un utilizzo medio, e cosi' e' l'infrastruttura di rete: quindi l'idea di una “partenza intelligente”, se pianifichi il viaggio nelle ore di punta, e' probabile che verrai rallentato dagli ingorghi.

- Neutralita': ci sono leggi che vietano ai camion l'accesso alle autostrade nei weekend “caldi”, tranne quelli che trasportano merci deperibili. Questa e' regolamentazione istituzionale, non dell'ISP.

- I costi sono distribuiti su piu' fattori (distanza, tipo di veicolo, ecc.)

- DPI: recentemente le autostrade italiane hanno introdotto autovelox a tratta), e' il parallelo perfetto con la DPI sulle reti a pacchetto!

- Digital divide: non tutti i comuni sono raggiunti da un'autostrada, proprio come le DSL (ma e' una vergogna, nota del redattore).

- Conclusione: servono regolamentazioni sensate progettate da una tavola rotonda scientifica, e tali regolamentazioni devono essere tenute aggiornate, perche' l'ecosistema di Internet e' in costante evoluzione.

- Applauso.

- Pensate a Internet come

un'autostrada, cosi' possiamo ragionare meglio.

Roberto Scrivo – Fastweb – (Punteggio: 1)- Servono regolamentazioni

- Soffriamo di mancanza di competenza tecnologica

- La neutralita' non e' il problema qui, e' solo questione di gestione

- Implementeremo le NGN quando saranno redditizie

E infine Eugenio Prosperetti dell'ISIMM (ragazzi, sistematevi l'encoding sul sito ;) ha fatto un riepilogo dei concetti espressi dai portavoce delle telco e ha insistito sulla necessita' di accessibilita' di un servizio che sta diventando uno strumento comune per lavorare. Servono il 4G, serve la fibra, e lo Stato dovrebbe promuovere queste questioni (e non demonizzare Internet, nota del redattore).

Politica

Paolo Gentiloni, ex ministro delle telecomunicazioni, ha detto che lo Stato non sta solo a guardare: avra' un ruolo prominente nel futuro. Ha detto che Microsoft ha riportato che nel 2010 l'uso di internet superera' la TV tradizionale, e come tale il carico di lavoro sulla Pubblica Amministrazione aumentera', anche perche' la PA se l'e' persa (ehi, questo mi ricorda quando Ballmer di Microsoft ha dichiarato che abbiamo mancato internet). Ha anche ricordato un Rapporto Caio che promette di coprire il 99% della popolazione con DSL o fibra entro il 2011, se i lavori inizieranno a giugno 2009 (vedremo, nota del redattore).

AGGIORNAMENTO: Il Rapporto Caio e' stato pubblicato su WikiLeaks il 15 maggio 2009 (grazie Quinta per la condivisione).

E' difficile per la UE implementare pratiche di sviluppo infrastrutturale come quelle asiatiche, dove lo Stato prende decisioni e le imprese le eseguono... perche' in un mondo capitalista l'unica cosa che conta e' il ROI. Dobbiamo trovare un equilibrio sano per tutti, e ci stiamo lavorando.

Conclusioni

In breve, l'evento e' stato interessante, un po' pleonastico perche' gli stessi argomenti sono stati ripresi piu' e piu' volte durante la giornata, ed e' stato un inquadramento della situazione attuale (territorio inesplorato), ma almeno ho sentito politici dire “si', internet e' importante, ha valore, e vale la pena investirci”. Non ricordo quante volte ho detto queste parole in passato.

Spero sia stata una bella lettura, e complimenti per essere arrivati fino alla fine!